Modelle zur strukturellen Einbindung von Künstlicher Intelligenz |

Ein Vergleich verschiedener Organisationsansätze

| Zeitschrift | Industry 4.0 Science |

| Ausgabe | 41. Jahrgang, 2025, Ausgabe 5, Seite 144-151 |

| Open Access | https://doi.org/10.30844/I4SD.25.5.144 |

| Literatur | Teilen | Zitieren | Download |

Abstract

Keywords

Artikel

Verbreitete Nutzung Künstlicher Intelligenz ohne klare organisatorische Integration

Künstliche Intelligenz (KI) wird heute in nahezu allen betrieblichen Funktionsbereichen eingesetzt: von Produktion und Instandhaltung über Logistik, Personalmanagement bis hin zu Marketing und Kundenservice (Bild 1). Unternehmen nutzen KI, um Prozesse zu automatisieren, Entscheidungen datenbasiert zu unterstützen und neue Wertschöpfungspotenziale zu erschließen. Die Breite der Einsatzfelder markiert einen Wandel, der sowohl Technologie, als auch Organisation [1] und Führung [2] betrifft.

Angesichts dessen stellt sich die Frage nach der organisatorischen Verantwortung für die Einführung von KI im Unternehmen. Im Rahmen des ifaa-Trendbarometers „Arbeitswelt“ des ifaa – Institut für angewandte Arbeitswissenschaft wurde unter anderem untersucht, wie die Verantwortung für die Implementierung von KI in Unternehmen geregelt ist [4]. Die Ergebnisse einer Befragung von 531 Beschäftigten aus verschiedenen Hierarchieebenen der Wirtschaft zeigen einen signifikanten Zusammenhang zwischen der Unternehmensgröße und der organisatorischen Klarheit (Bild 2).

![Bild 1: Einsatzmöglichkeiten der KI [3].](https://industry-science.com/wp-content/uploads/2025/09/Stowasser_Bild1-1024x724.jpg)

In größeren Unternehmen (500+ Mitarbeiter) ist die Verantwortung für KI überwiegend gut geregelt: 30 % benennen eine verantwortliche Person, 47 % haben eine spezielle Organisationseinheit, und nur 11 % haben keine feste Zuständigkeit. Im Mittelstand (100–499 Mitarbeiter) setzen 50 % auf Organisationseinheiten und 24 % auf Einzelpersonen, während 14 % keine klare Regelung haben. In kleinen Unternehmen (bis 99 Mitarbeiter) fehlen in 40 % der Fälle sowohl benannte Rollen als auch organisatorische Einheiten, weitere 17 % wissen es nicht oder machen keine Angaben.

![Bild 2: Verantwortung für die Einführung von Künstlicher Intelligenz [4].](https://industry-science.com/wp-content/uploads/2025/09/Stowasser_Bild2-1024x677.jpg)

Diese Zahlen zeigen, dass besonders kleinere Unternehmen oft keine klaren Verantwortlichkeiten für KI haben. Die Einführung erfolgt daher meist unsystematisch und ohne strukturelle Absicherungen wie Governance-Regeln oder strategische Einbindung. Das folgende Kapitel greift diese Lücke auf und zeigt, wie Unternehmen KI organisatorisch verankern können und mit welchen Modellen, Rollen und Führungsmechanismen dies gelingen kann.

Ansätze der organisatorischen Verortung von Künstlicher Intelligenz

Mit der Integration von KI in Arbeitsprozesse müssen Unternehmen neue Verantwortlichkeiten und Steuerungsmechanismen schaffen. KI beeinflusst bestehende Strukturen und erfordert klare Zuständigkeiten, funktionierende Governance und bewusste Einbindung.

Unternehmen sollten daher klare Verantwortlichkeiten regeln, da diese für den nachhaltigen KI-Einsatz maßgeblich sind.

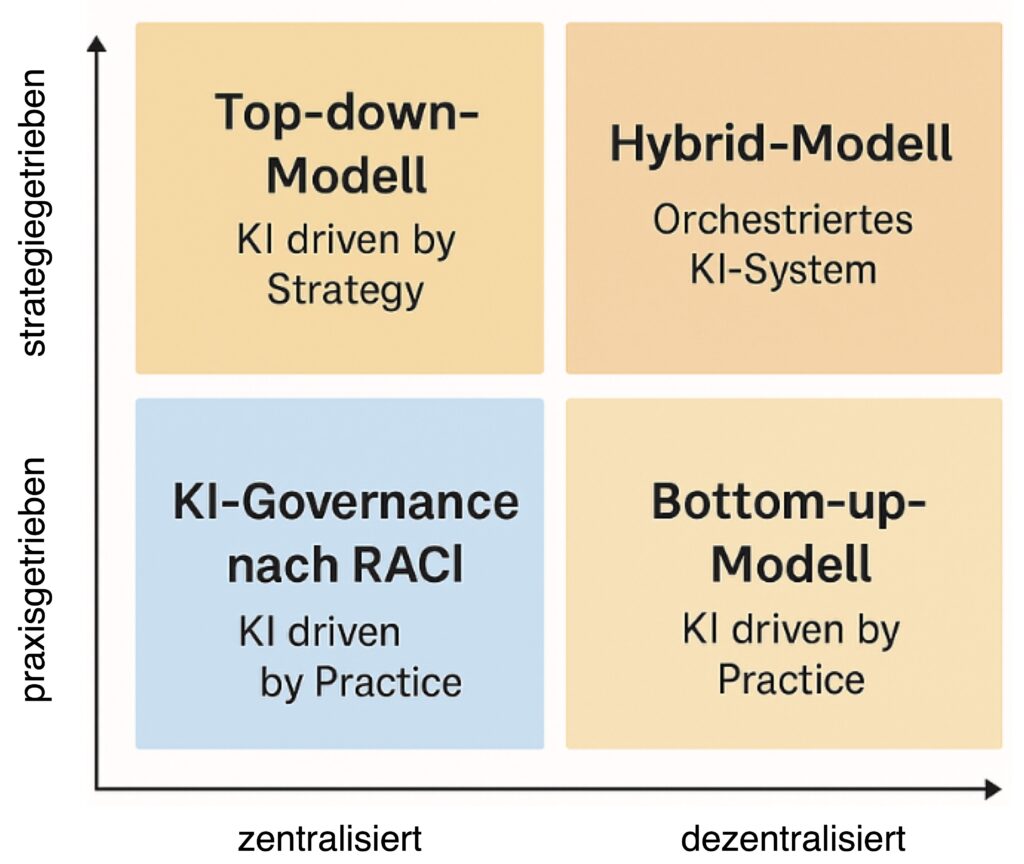

Bild 3 zeigt vier verschiedene Ansätze zur organisatorischen Verortung von KI in Unternehmen. Diese fügen sich in ein Spannungsfeld aus Skalierbarkeit und Effizienz sowie Flexibilität und Anwendungsnähe ein.

Die folgenden Abschnitte stellen diese Modelle vor und evaluieren derenImplikationen für die Führung, die Skalierbarkeit und die nachhaltige Implementierung von KI.

Top-down-Modell: Strategiegesteuerte Verantwortung für Künstliche Intelligenz

Das Top-down-Modell der KI-Verantwortung folgt einem klar hierarchischen Steuerungsprinzip, in dem strategische Entscheidungskompetenz und Verantwortung auf der obersten Führungsebene konzentriert sind. Im Zentrum steht dabei beispielsweise die Rolle eines Chief AI Officer (CAIO), Chief Artificial and Data Officer (CAIDO) oder Chief AI Transformation Officer (CATO), die gezielt geschaffen wurden, um dem strategischen Gewicht von KI im Unternehmen gerecht zu werden. Dem CAIO ist in der Regel ein interdisziplinäres Steuerungsgremium (z. B. AI-Strategy Board) nachgeordnet.

In diesem Board sind Schlüsselbereiche wie IT, Recht, HR, Datenschutz (Data Governance) und der Betriebsrat vertreten. Ziel ist es, einen strategischen Rahmen für den KI-Einsatz zu definieren, ethische und rechtliche Leitplanken zu setzen und zugleich eine koordinierte Umsetzung zu gewährleisten. Die operative Verantwortung für die Umsetzung entsprechend der Strategie definierter Anwendungsfälle liegt bei den jeweiligen Fachabteilungen, die entlang zentraler Vorgaben agieren und entsprechende Systeme implementieren.

Ein solches Modell hat mehrere Vorteile: Es schafft klare Zuständigkeiten, ermöglicht strategische Steuerung über Bereichsgrenzen hinweg und optimiert Ressourcenverwendung. Besonders bei umfassenden KI-Transformationsprogrammen hilft die zentrale Steuerung, Doppelentwicklungen zu vermeiden und Synergien zu nutzen.

Es gibt jedoch auch Herausforderungen: Die Mitarbeitereinbindung ist oft geringer, was die Akzeptanz erschwert, besonders wenn operative Realitäten und strategische Vorgaben nicht gut abgestimmt sind. Zudem könnten innovative Ideen aus der Fachabteilung übersehen werden, da Entscheidungen meist von oben nach unten getroffen werden. Führungskräfte müssen daher nicht nur zentrale Vorgaben umsetzen, sondern auch als Rückmeldeinstanzen dienen, um operative Erkenntnisse in die Strategieebene einzubringen.

Das Top-down-Modell eignet sich insbesondere für Organisationen mit hoher Regulierungsdichte, klarer Linienstruktur oder großem Koordinationsbedarf. Voraussetzung für den KI-Einsatzerfolg ist, dass die strategische Steuerung durch Kommunikations- und Beteiligungsformate begleitet wird.

Bottom-up-Modell: Künstliche Intelligenz aus der Praxis heraus gestalten

Das Bottom-up-Modell setzt konsequent auf die Innovationskraft und Anwendungsnähe operativer Teams. Im Zentrum steht dabei die Überzeugung, dass jene Mitarbeitenden, die mit Prozessen, Systemen und Herausforderungen im Tagesgeschäft unmittelbar vertraut sind, auch am besten in der Lage sind, sinnvolle und wirkungsvolle Anwendungsfälle für KI zu identifizieren.

Der Anstoß zur KI-Nutzung erfolgt in diesem Modell nicht durch zentrale strategische Vorgaben, sondern durch konkrete Problemstellungen und Optimierungsideen „von unten“.

Operative Teams (ggf. auch Einzelpersonen) bilden den Ausgangspunkt der Entwicklung. Sie formulieren Anwendungsbedarfe, erproben erste Prototypen und treiben die praktische Umsetzung voran. Unterstützt werden sie dabei durch sogenannte Communities of Practice, d. h. selbstorganisierte Netzwerke aus verschiedenen Unternehmensbereichen, die Wissen, Erfahrungen und Tools rund um KI teilen. Diese Communities dienen nicht nur der methodischen Weiterentwicklung, sondern auch der übergreifenden Koordination und Qualitätssicherung. Auf einer übergeordneten Ebene bündelt ein KI-Kompetenzzentrum technische, methodische und rechtliche Unterstützung. Es stellt sicher, dass grundlegende Anforderungen wie Datenschutz, IT-Governance oder Ethik beachtet werden und bietet begleitende Schulungs- und Qualifizierungsformate an.

Ein großer Vorteil dieses Modells ist die unmittelbare Praxisnähe. KI-Lösungen werden dort entwickelt, wo sie gebraucht werden, was die Akzeptanz und Nutzung bei den Beschäftigten erhöht. So entstehen oft kreative und ressourcenschonende Lösungen, die die Innovationskraft der Organisation stärken.

Nachteil des Bottom-up-Modells ist das Risiko der Fragmentierung ohne strategische Ausrichtung: Es könnten schwer skalierbare Insellösungen entstehen. Außerdem fehlt es operativen Teams oft an Ressourcen, um KI-Projekte über Prototypen hinauszuführen. Führungskräfte müssen ihre Teams unterstützen und dafür sorgen, dass Projekte in übergeordnete Ziele integriert bleiben und Governance-Vorgaben eingehalten werden.

Das Bottom-up-Modell ist besonders geeignet für innovationsorientierte Unternehmen mit flachen Hierarchien, hoher Partizipationskultur und einem starken Fokus auf Selbstorganisation. Damit es langfristig tragfähig bleibt, braucht es jedoch ergänzende Strukturen zur strategischen Abstimmung, Ressourcensteuerung und Qualitätssicherung.

Hybrid-Modell: Integration von Strategie und Umsetzung

Das Hybrid-Modell verfolgt das Ziel, die Vorteile zentraler Steuerung mit der Innovationskraft dezentraler Umsetzung zu verbinden. Es basiert auf einer arbeitsteiligen Architektur, in der eine strategisch verankerte Steuerungsinstanz, z. B. etwa ein KI-Lenkungsausschuss, den organisatorischen Rahmen vorgibt, während operative Verantwortung bei den Fachbereichen verbleibt. Zwischen beiden Ebenen wirkt ein KI-Team als Vermittlungsinstanz: Es übersetzt strategische Anforderungen in operative Handlungsfelder, koordiniert die Kommunikation zwischen Linie und Strategie und unterstützt bei der praxisgerechten Umsetzung.

In den Fachbereichen selbst werden KI-Vertretungen etabliert, z. B. in Form von Data Stewards, KI-Multiplikatoren oder „KI Ambassadors“. Diese Personen übernehmen eine Doppelrolle: Einerseits fördern sie die Identifikation, Spezifikation und Umsetzung von Anwendungsfällen vor Ort, andererseits tragen sie Anforderungen, Feedback und Erkenntnisse zurück in die strategische Steuerung. Dadurch entsteht eine lernende Organisation, die technologische Entwicklung, Führungsarbeit und Kompetenzaufbau kontinuierlich verzahnt.

Die Kombination aus Top-down-Rahmung und Bottom-up-Partizipation ermöglicht es, sowohl unternehmensweite Standards durchzusetzen als auch kontextspezifische Lösungen zu entwickeln. Dadurch eignet sich dieses Modell besonders für größere, heterogene Organisationen mit differenzierten Anforderungen.

Gleichzeitig verlangt das Hybrid-Modell nach einem ausgeprägten Koordinationsvermögen. Die Vielzahl an beteiligten Rollen, Ebenen und Schnittstellen macht ein klar strukturiertes Zusammenspiel erforderlich. Ohne geeignete Kommunikations- und Steuerungsformate besteht die Gefahr, dass Abstimmungsprozesse ineffizient werden oder Verantwortlichkeiten unklar sind.

Das Hybrid-Modell ist keine „Kompromisslösung“, sondern eine Organisationsform, die Partizipation, strategische Konsistenz und Lernfähigkeit fördert. Es eignet sich besonders für kooperations- und wissensorientierte Organisationen, die KI als Teil einer kulturellen Transformation sehen.

Projektorientierte Governance nach dem RACI-Modell

Das RACI-Modell ist ein bewährtes Instrument zur Strukturierung von Verantwortlichkeiten in Projekten [5], [6] und lässt sich auch für die Einführung und Steuerung von KI-Anwendungen nutzen. Im Kontext von KI-Projekten kommt es besonders auf Transparenz und Nachvollziehbarkeit an: Wer entscheidet, wer führt aus, wer wird einbezogen und wer wird informiert? Hier setzt das RACI-Modell an, indem es für jede Aufgabe oder jeden Anwendungsfall eine klare Rollenverteilung vornimmt: R für „Responsible“, A für „Accountable“, C für „Consulted“ und I für „Informed“.

In KI-Projekten, wie etwa der Einführung generativer KI im Recruiting oder Vertrieb, ermöglicht das RACI-Modell eine differenzierte und transparente Aufgabenverteilung. Die eigentliche Umsetzung durch einen Data Scientist oder ein operatives Team liegt bei der „Responsible“-Rolle. Die „Accountable“-Rolle, also die Gesamtverantwortung, bleibt beim Top-Management oder spezifischen Rollen wie beispielsweise einem CAIDO (Chief Artificial and Data Officer). Gleichzeitig werden zentrale Stakeholder wie IT-Security, Rechtsabteilung oder Betriebsrat als „Consulted“ eingebunden, um sicherzustellen, dass Compliance, Datenschutz und interne Richtlinien eingehalten werden. Die „Informed“-Rolle sorgt schließlich dafür, dass betroffene Teams, Führungskräfte und externe Partner informiert werden.

Das RACI-Modell bietet Klarheit: Jeder weiß, worauf er Einfluss hat und wofür er verantwortlich ist. Dies ist besonders nützlich in sensiblen oder interdisziplinären KI-Projekten und fördert Akzeptanz und Effizienz. Es bietet zudem hohe Rechtssicherheit durch dokumentierte Zuständigkeiten.

Das Modell eignet sich jedoch vor allem für konkrete Projekte oder Teilprozesse, nicht als umfassende Governance-Struktur für den gesamten KI-Einsatz. Es strukturiert Rollen im operativen Bereich und kann für Organisationen ohne etablierte KI-Governance ein guter Einstieg bei Pilotprojekten sein.

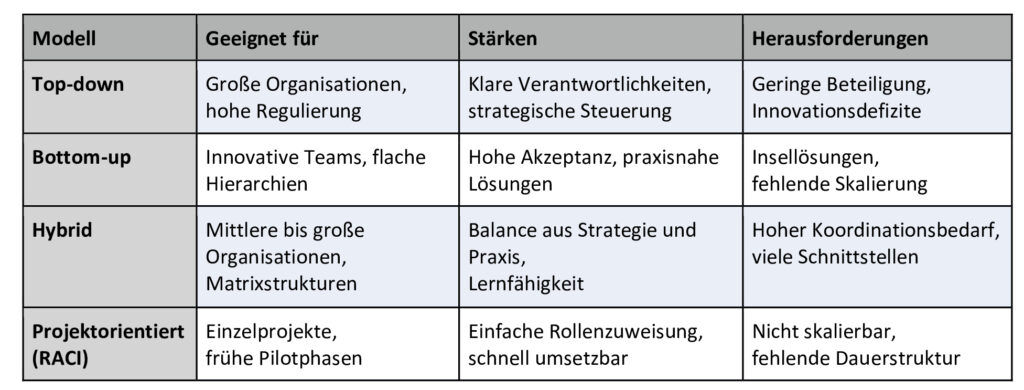

Die Zukunft der organisatorischen Verankerung von Künstlicher Intelligenz

Die vorliegenden Überlegungen haben gezeigt, dass die organisatorische Verankerung von Künstlicher Intelligenz ein entscheidender Erfolgsfaktor für deren nachhaltige Nutzung ist. In Bild 4 werden die vier unterschiedlichen Modelle – zentral, dezentral, hybrid und projektbezogen – dargestellt und systematisch gegenübergestellt, um Unternehmen Orientierung für die Wahl eines passenden Organisationsansatzes zu bieten.

Es wird deutlich, dass die Diskussion über organisatorische Modelle noch am Anfang steht. Bislang gibt es nur wenige empirisch fundierte Studien darüber, wie diese Modelle konkret umgesetzt werden, welche Herausforderungen dabei entstehen und welche Faktoren ihren Erfolg beeinflussen. Es mangelt an belastbaren Daten zur betrieblichen Umsetzung der Modelle, zu Wechselwirkungen mit Führung und Mitbestimmung sowie zur Integration von Governance-Mechanismen.

Die konkreten Erfahrungen von Unternehmen mit verschiedenen Verankerungsmodellen sollten systematisch erhoben werden. Dazu gehören sowohl qualitative Fallstudien als auch quantitative Analysen zu Rollenzuschnitten, Steuerungsformen, Beteiligungsprozessen und Wirkungen auf Akzeptanz und Implementierungserfolg. Offene Forschungsfragen bleiben unter anderem:

- Wie werden KI-Modelle in unterschiedlichen Branchen, Betriebsgrößen und Kulturen konkret implementiert?

- Welche Governance-Formate fördern Verlässlichkeit, Partizipation und Innovationsfähigkeit?

- Wie verändern sich klassische Rollenprofile und Entscheidungslogiken durch KI-Projekte?

- Welche Faktoren machen ein organisatorisches Modell langfristig tragfähig?

Dies ist ein Originalbeitrag. Die englische Übersetzung finden Sie unter der DOI: 10.30844/I4SE.25.5.138

Literatur

[1] ifaa – Institut für angewandte Arbeitswissenschaft e. V.: Arbeitsorganisation neu gedacht – Erfolgsfaktoren für die KI-Einführung. https://www.arbeitswissenschaft.net/fileadmin/user_upload/Broschuere_KI_Arbeitsorganisation_7_final.pdf, Abrufdatum 20.03.2025.[2] Plattform Lernende Systeme. Führung im Wandel: Herausforderungen und Chancen durch KI. https://www.plattform-lernende-systeme.de/files/Downloads/Publikationen/AG2_WP_Fuehrung_im_Wandel.pdf, Abrufdatum 14.12.2024.

[3] ifaa – Institut für angewandte Arbeitswissenschaft e. V.: ifaa erklärt KI. https://www.arbeitswissenschaft.net/fileadmin/_processed_/c/c/csm_ifaa_erklaert_KI_final_59d9ca43f2.jpg, Abrufdatum 12.01.2025.

[4] ifaa – Institut für angewandte Arbeitswissenschaft e. V.: ifaa Trendbarometer Arbeitswelt. https://www.arbeitswissenschaft.net/fileadmin/user_upload/KI-Trendbarometer-2023.pdf, Abrufdatum 02.06.2025

[5] Blokdyk, G. (2020). RACI Matrix – A Complete Guide – 2020 Edition. 5STARCooks.

[6] Brown, J. (2010). The handbook of program management (2nd ed.). McGraw-Hill.