KI-Kompetenzen für eine verantwortungsvolle Nutzung |

Realistische Lernumgebungen, kritisches Denken und Rollengestaltung in Teams

| Zeitschrift | Industry 4.0 Science |

| Ausgabe | 42. Jahrgang, 2026, Ausgabe 1, Seite 100-107 |

| Open Access | https://doi.org/10.30844/I4SD.26.1.100 |

| Literatur | Teilen | Zitieren | Download |

Abstract

Keywords

Artikel

Die fortschreitende Integration Künstlicher Intelligenz (KI) in betriebliche Arbeitsprozesse stellt Unternehmen und Beschäftigte vor neue Herausforderungen und eröffnet zugleich vielfältige Potenziale zur Steigerung von Effizienz und Innovationsfähigkeit [1]. Während die Nutzung von generativer KI in vielen Unternehmen rasant ansteigt, rückt zunehmend die Frage in den Fokus, wie Beschäftigte im Umgang mit KI professionalisiert werden können, wenn menschliche Problemlösung mit KI-Systemen unterstützt werden soll [2]. Insbesondere die Entwicklung von Fähigkeiten, KI-Systeme zielgerichtet, kritisch und reflektiert in Arbeitsprozesse zu integrieren, gilt als Schlüsselfaktor für die erfolgreiche Nutzung von KI-Technologien [3].

Erste Studien zu mittel- und langfristiger Veränderung von Arbeit mit KI-Unterstützung zeigen, dass Produktivitätsgewinne in Teilen mit reduziertem kritischen Denken bei der Problemlösung einhergehen [4]. Bestehende Ansätze zur Entwicklung von KI-Kompetenz fokussieren meist individuelles deklaratives Wissen über KI (Funktionsweise, gesetzliche Rahmenbedingungen) sowie individuelles prozedurales Wissen (z. B. Prompten, kritische Prüfung von KI-Outputs). Ansätze zur Entwicklung von Arbeitsteams oder Organisationen zur zeitlich stabilen Verbesserung von Arbeitsergebnissen und Problemlösekompetenz auf Systemebene sind noch kaum entwickelt [5]. Diese sind jedoch erforderlich, um jene Herausforderungen angewandter KI-Ethik anzugehen, die sich um Augmentierung durch KI-Einsatz und Bedeutsamkeit von Arbeit drehen [6, 7].

Vor diesem Hintergrund untersucht der vorliegende Beitrag die Forschungsfrage: Welche systemischen Wirkungen von KI-Integration in Arbeitsprozesse lassen sich in einem arbeitsplatznahen Simulationssetting identifizieren? Diese Frage wird mit Blick darauf untersucht, welche Trainingsansätze am besten geeignet sind, KI-Kompetenzen zu fördern, die einen verantwortungsvollen Einsatz von KI in Arbeitsprozessen sicherstellen. Dieser Beitrag liefert erste Evidenz aus vier Testläufen in einer arbeitsplatznahen Simulationsumgebung und bietet somit einen qualitativ-explorativen Ansatzpunkt für zukünftige Untersuchungen.

Theoretischer Hintergrund

Spätestens seit den Fortschritten in generativer KI und der hohen Bekanntheit und Verbreitung seit 2022 ist KI-Nutzung in Organisationen mit Adoptionsraten von ca. 25 % bereits weit verbreitet, und der Trend setzt sich fort [8]. Für diese Entwicklung spielt das Potenzial dieser Technologien zur Steigerung von Produktivität eine wichtige Rolle. Während der produktivitätssteigernde Effekt generativer KI bereits überzeugend in einem umfassenden Literaturreview belegt werden kann [9], machen die Autoren des Reviews deutlich, dass erhebliche Bedarfe in der Untersuchung notwendiger Fähigkeiten und Kompetenzen für den Einsatz von KI bestehen und insbesondere innovative Trainingsansätze erforderlich sind. Diese können nicht nur dabei helfen, die Produktivität zu steigern, sondern spielen auch eine wichtige Rolle in der Literatur zu menschengerechter KI-Nutzung und bedeutsamer Arbeit [6, 7].

KI-Kompetenz umfasst unterschiedliche Bereiche menschlichen Handelns. Zum einen wird in der Literatur auf Fähigkeiten verwiesen, KI zielorientiert einzusetzen, effektiv zu bedienen und KI-Modelle auf Anwendungsfälle zuzuschneiden sowie mit KI erzeugte Ausgaben kritisch zu prüfen. Zum anderen werden Fähigkeiten in ethischen Abwägungen und kritischem Denken bei der Problemlösung und Kreativität genannt [3, 10]. Letztere beziehen Kompetenz nicht auf die Bedienung der Technologie, sondern auf die zielorientierte und fundierte Abwägung von Chancen und Risiken der KI-Nutzung in einem bestimmten Anwendungskontext.

Es ist nachvollziehbar, dass Kompetenz zur zielorientierten Nutzung und effektiven Bedienung zu kurzfristigen Effizienzgewinne führen kann. Für einen langfristig erfolgreichen Einsatz von KI in Arbeitsprozessen sind jedoch auch ethische Abwägungen und kritische Reflexion von großer Bedeutung. Dies wird durch aktuelle Studien unterstrichen, die zeigen, dass die häufige Nutzung von KI mit einer Reduktion der Fähigkeit zum kritischen Denken einhergehen kann [4].

Diese Wirkung der KI-Nutzung wird damit erklärt, dass Beschäftigte kognitive Aufgaben an die KI abtreten (cognitive offloading) [11]. Hohe Kompetenzen in der Bedienung und Nutzung von KI können also in einem Spannungsfeld mit Kompetenzen zur ethischen Reflexion und zum kritischen Denken stehen. Folglich sind beide Bereiche für die betriebliche Kompetenzentwicklung im Kontext der Nutzung von KI in Arbeitsprozessen von Bedeutung.

Die Forschung zur Entwicklung von KI-Kompetenz in Organisationen steht noch am Anfang. In einzelnen Studien werden strukturierte Programme vorgestellt. Diese verbinden die technische Anleitung und die ethische Reflexion und bestehen aus einer Vielzahl unterschiedlicher Formate [12, 13]. Es konnte zwar eine gewisse Übertragbarkeit von Erkenntnissen aus der Bildungsforschung festgestellt werden [14], jedoch sind gerade solche Ansätze nicht auf die innerbetrieblichen Auswirkungen von KI-Nutzung ausgerichtet und beschäftigen sich lediglich mit der Bedienung und Reflexion von KI-Systemen.

Diese Studie fokussiert die Entwicklung von KI-Kompetenz in einem Trainingssetting, das Teams die Bedienung von KI sowie die kritisch-reflexive Problemlösung unter Nutzung von KI erfahren lässt.

Methodik

Untersuchungskontext

Die Untersuchung erfolgt im Mensch-KI-Rollenentwicklungslabor, das im Forschungsprojekt entwickelt wurde, um Interaktion mit KI im Arbeitsprozess in einem Trainingssetting erlebbar und reflektierbar zu machen. Es handelt sich um ein arbeitsplatznahes Simulationslabor, in dem Gruppen einen Arbeitsprozess erlernen und diesen über fünf Phasen hinweg ausführen. Die Teams schlüpfen in die Rolle eines Analyseteams eines fiktiven Gesundheitsdienstleisters mit datenbasiertem Geschäftsmodell.

Die Prämisse ist, dass Kunden das Unternehmen beauftragen, eine unabhängige Gesundheitsempfehlung auf Basis zahlreicher Daten (EKG-Daten, Gesundheitsdaten aus Fitnesstrackern, Patienteninformationen wie Arztberichte, Vorerkrankungen, anamnestische Informationen etc.) zu erstellen. Die KI-Unterstützung besteht aus zwei spezifischen Auswertungsassistenten, die EKG-Daten und Gesundheitsdaten auswerten können. Der KI-Modus lässt sich jeweils in der Auswertungssoftware zuschalten und bietet eine visuelle und textuelle Klassifikation.

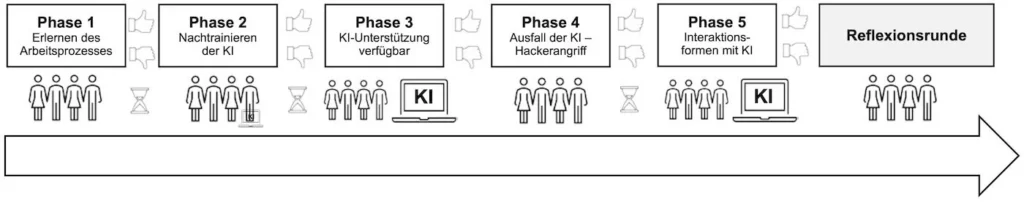

Jede Gruppe durchläuft die Phasen sequenziell. In Phase 1 wird der Arbeitsprozess ohne KI-Unterstützung erlernt und der erste Kundenfall gelöst. In der zweiten Phase wird ein weiterer Kundenfall gelöst und zeitgleich Feedback an die beiden neu eingeführten KI-Systeme übermittelt (labeling). In der dritten Phase werden die beiden KI-Assistenten genutzt und erste Erfahrungen mit der KI-Unterstützung gesammelt.

In der vierten Phase unterbricht ein Hackerangriff den gewohnten Arbeitsablauf und macht einen Rückgriff auf die ursprünglichen Arbeitsabläufe notwendig, um den Kundenfall zu bearbeiten. Zudem wird an der Reaktivierung der Systeme gearbeitet. In der fünften Phase werden unterschiedlich gelagerte Kundenfälle mit KI-Unterstützung bearbeitet und neue Routinen etabliert. Der Ablauf ist in Bild 1 dargestellt.

Nach Durchlaufen aller fünf Phasen wird der Simulationskontext verlassen und eine Reflexionsrunde angeschlossen. Diese ist zentral für den beabsichtigten Lernprozess und soll auch die Übertragung der Erfahrungen in reale Arbeitsprozesse der Teams vorbereiten.

Datenerhebung

Die Datenerhebung fand im April und Mai 2025 mit vier Testgruppen statt. Die Testgruppen bestanden zweimal aus vier und zweimal aus sieben Mitgliedern. Zwei Gruppen bestanden aus Beschäftigten der Universität, eine Gruppe bestand aus einem Unternehmen der Gesundheitsbranche und eine Gruppe bestand aus Masterstudierenden. Bei allen vier Testgruppen waren zwei bis drei Mitglieder des Autorenteams im Raum anwesend, um unerwartete Probleme (technisch, organisatorisch) beheben zu können. Je eines dieser Mitglieder erstellte ein Beobachtungsprotokoll, das mit den weiteren anwesenden Mitgliedern abgeglichen und bei Bedarf ergänzt wurde.

Im Beobachtungsprotokoll wurde festgehalten, welche Arbeitsergebnisse erzielt wurden und wie die Teams in den Phasen mit und ohne KI gearbeitet haben (Arbeitsweisen). Zu den Arbeitsergebnissen zählte die benötigte Zeit für jede Phase sowie die vergebene Bewertung der Gesundheitsempfehlung (gut, mittel, schlecht – analog zum positiven, gemischten oder enttäuschten Feedback der Kund:innen). Zur Untersuchung von Arbeitsweisen wurden Codes zu folgenden drei Facetten notiert: a) Vorgehen bei der Lösungsfindung, b) Reflexionsprozesse bei der Problemlösung, c) Interpretation von Rollen für Teammitglieder und KI. Die drei Facetten entstammen Abwägungen zu beobachtbaren Facetten von Arbeitsweisen in der gegebenen Simulationsumgebung.

Datenanalyse

Ziel der Datenanalyse ist die systematische Erfassung von Wirkungen der KI-Integration auf Arbeitsergebnisse und Arbeitsweisen im Laufe der Simulation. Die Analyse der Beobachtungsdaten erfolgt mit einem induktiven, analytisch-interpretativen Ansatz [15]. Es wird untersucht, wie sich Arbeitsergebnisse und Arbeitsweisen bei Nutzung und Nichtnutzung von KI unterscheiden. Zu diesem Zweck wurden die Codes aller vier Teams innerhalb der Facetten Lösungsfindung, Reflexion bei Problemlösung und Mensch-KI-Rollen zu wiederkehrenden Themen aggregiert und Veränderungen im Hinblick auf die KI-Integration herausgearbeitet.

Ergebnisse

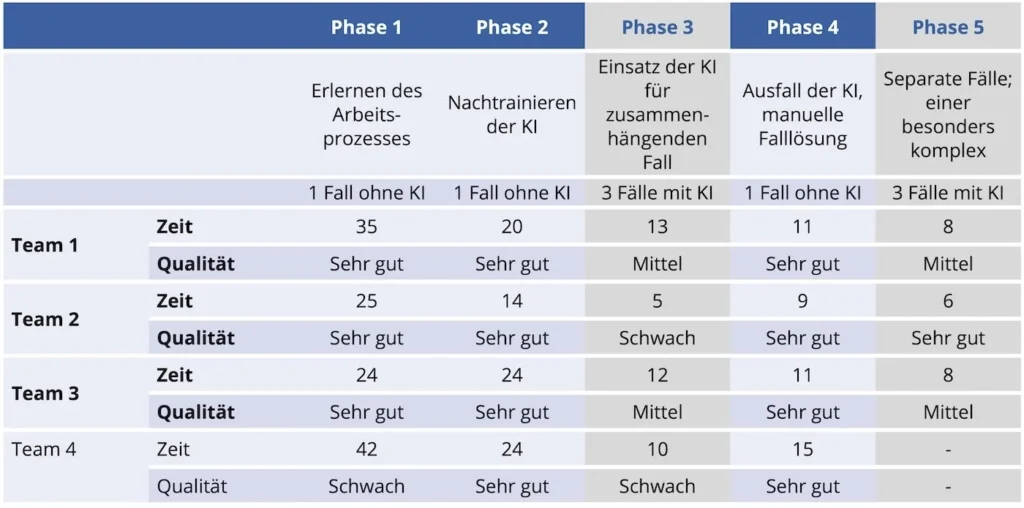

Zunächst wird die Entwicklung der Arbeitsergebnisse im Simulationsverlauf betrachtet. Die von den Probanden zur Analyse eines Falls und Absendung von Gesundheitsempfehlungen benötigte Zeit nimmt im Phasenverlauf ab. Die mittlere Zeit für einen Kundenfall ohne KI-Unterstützung liegt in Phase 1 bei 32 Minuten, in Phase 2 bei 21 Minuten, in Phase 4 bei 11 Minuten. Die mittlere Zeit mit KI-Unterstützung liegt in Phase 3 bei 10 Minuten und in Phase 5 bei 7 Minuten. Die Qualität ist im Phasenverlauf moderat absteigend. In den Phasen ohne KI wurde elf von zwölf Mal die Bestbewertung vergeben, mit KI nur in einem von sieben Fällen. Bild 2 gibt einen Überblick über die Arbeitsergebnisse.

Hinweise: Es ist jeweils die benötigte Zeit pro Kundenfall notiert. Bei Phase 4 wurde die Zeit für das Wiederherstellen des Systems nach dem Hackerangriff abgezogen. Phasen mit KI-Nutzung werden grau hervorgehoben. Die Teams 1 und 2 bestanden aus Beschäftigten der Universität, Team 3 aus Beschäftigten eines Unternehmens in der Gesundheitsbranche, Team 4 aus Studierenden.

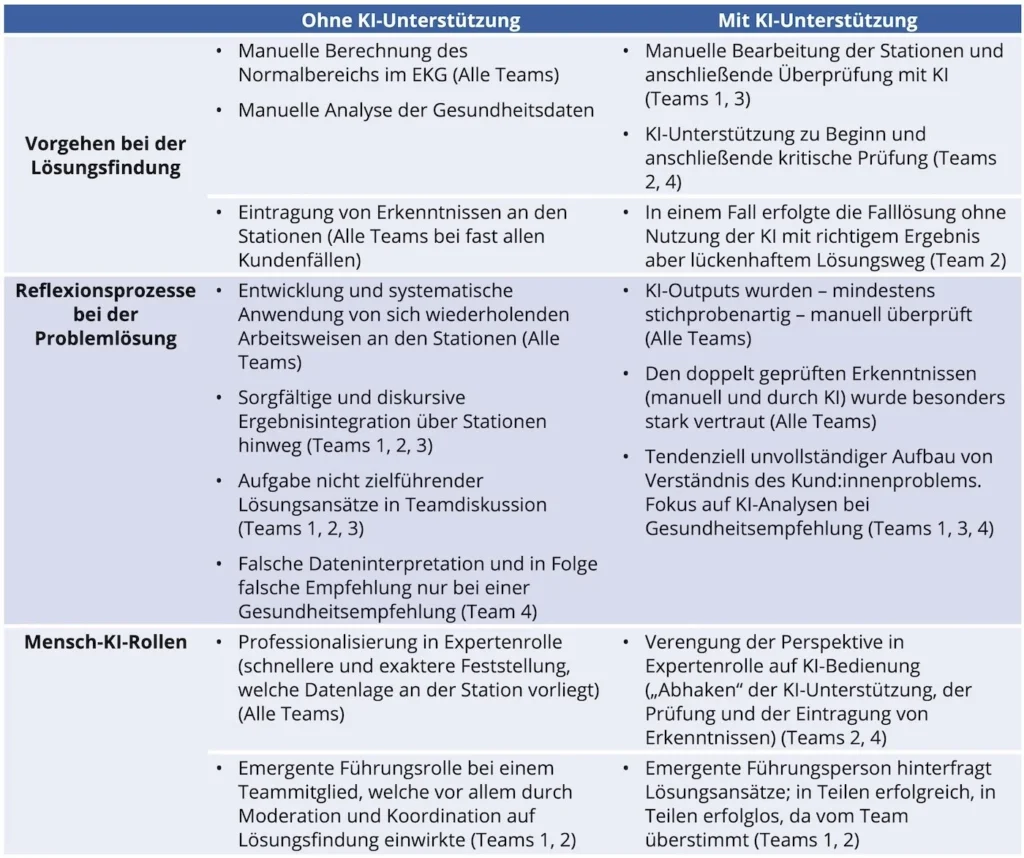

Im Folgenden werden Beobachtungen zu den Arbeitsweisen mit und ohne KI-Unterstützung für die Facetten Lösungsfindung, Reflexion bei Problemlösung und Mensch-KI-Rollen dargestellt (Bild 3).

Vorgehen bei der Lösungsfindung

Die Lösungsfindung erfolgte mit und ohne KI-Unterstützung auf ähnliche Weise. Die einzelnen Stationen wurden teils nacheinander, teils parallel bearbeitet und Erkenntnisse festgehalten. Die Ableitung von Gesundheitsempfehlungen erfolgte auf Basis aller gesammelten Erkenntnisse und als Folge einer Gruppendiskussion. Die KI-Unterstützung wurde auf unterschiedliche Weise eingesetzt. Zwei Teams nutzten die KI zur Überprüfung ihrer vorher manuell erzielten Erkenntnisse. Zwei Teams griffen direkt auf die KI zurück und überprüften im Anschluss – meist stichprobenartig – die Richtigkeit der KI-Analyse.

Reflexionsprozesse bei der Problemlösung

Gelegentlich wurden Lösungsansätze vorgeschlagen, die sich in der gemeinsamen Diskussion als nicht korrekt herausstellten und somit verworfen wurden. Wenn keine KI-Unterstützung verfügbar war, gelang es in elf von zwölf Fällen, den Fall so ausreichend zu durchdringen, dass die Gesundheitsempfehlung mit „sehr gut“ bewertet wurde. In den Fällen mit KI-Unterstützung gelang die Durchdringung der Fälle insgesamt weniger gut. Sowohl in Phase 3 als auch in Phase 5 waren die Fälle so konstruiert, dass zwar Auffälligkeiten in den EKG-Daten oder den Gesundheitsdaten auftraten, diese aber unter Berücksichtigung der Informationen aus den anderen Stationen nicht als problematisch im Sinne des Gesundheitszustandes der Kund:innen zu werten waren.

Drei von vier Teams deuteten dennoch die Auffälligkeiten als krankheitswert (teilweise sogar obwohl einzelne Teammitglieder dies hinterfragten). In den Diskussionen wurden in solchen Fällen dann vor allem die KI-Analysen ins Zentrum gestellt. Dies könnte damit zusammenhängen, dass diesen doppelt geprüften Erkenntnissen besonderes Vertrauen geschenkt wurde. Es gelang den Teams nicht, auf die gleiche Weise wie in den Phasen ohne KI-Unterstützung vorzugehen und somit unzureichende Lösungsansätze auszuschließen.

Mensch-KI-Rollen

In allen Teams bildeten sich Expertenrollen heraus (Expert:in für das EKG, Expert:in für Gesundheitsdaten etc.), wobei jeweils mindestens zwei Personen dieselbe Station bearbeiteten. Tendenziell beschränkten sich die Experten innerhalb der Teams unter Nutzung von KI auf die Bedienung der Station und die Prüfung der KI-Ergebnisse, und zeigten weniger Reflexion über die Relevanz der Ergebnisse im Hinblick auf den Kundenfall als vor der KI-Einführung. Nutzung von Expertenwissen für die bessere Durchdringung des Falls konnte kaum mehr beobachtet werden.

In zwei Teams übernahmen zwei Personen im Verlauf der Simulation Führungsrollen und wirkten moderierend und hinterfragend auf die Problemlösung ein. Sie waren damit nur teilweise erfolgreich, insbesondere dann nicht, wenn die jeweiligen Experten ihre Lösungsansätze mit den KI-unterstützten Analysen stützten. Der KI-Unterstützung selbst wurde in allen Teams eine Werkzeugfunktion zugedacht. Tendenziell wurden KI-unterstützte Ergebnisse als besonders relevant oder besonders gesichert behandelt.

KI-Integration verändert Arbeitsweisen und Arbeitsergebnisse

Die Ergebnisse der vier Testläufe im Mensch-KI-Rollenentwicklungslabor zeigen: Die Teams zeigen im Verlauf der Simulation Fortschritte in der Integration von KI in ihre Arbeitsprozesse. Sie prüfen die KI-Outputs kritisch und erreichen höhere Geschwindigkeiten mit KI-Unterstützung. Sie können jedoch die Qualität der zentralen Arbeitsergebnisse (Gesundheitsempfehlungen) nicht steigern, tendenziell sinkt diese sogar leicht. Das steht damit im Zusammenhang, dass die Arbeit mit KI-Unterstützung mit einer veränderten Herangehensweise an Problemlösungsverhalten im Team einhergeht. Die Teams sehen sich mit weitgehend gesicherten Erkenntnissen konfrontiert, ohne dass es ihnen gelingt, diese auf die gleiche Weise einzuordnen, wie es ohne KI-Unterstützung gelungen ist.

Die Ergebnisse knüpfen an bestehende Literatur an, die negative Effekte von KI-Nutzung auf kritisches Denken berichtet [4, 11]. Die vorliegende Studie zeigt, dass diese Effekte bereits innerhalb weniger Stunden in einem Simulationssetting beobachtet werden können. Zudem ist diese Beobachtung im Simulationssetting durch das Feedback zur Qualität und die geleitete Reflexionsrunde auch den Teammitgliedern zugänglich. Es liegt demnach nahe, dass ein erfahrungsbasierter und arbeitsplatznaher Simulationsansatz sowohl Facetten von KI-Kompetenz ansprechen kann, die sich auf die Bedienung von KI beziehen, als auch solche, die sich auf kritisch-reflektierte Problemlösung mit und ohne KI beziehen.

Die Studie lässt keine generalisierbaren Aussagen zu. Dies liegt zum einen an der sehr kleinen Zahl an Testgruppen. Zum anderen sind zahlreiche Alternativerklärungen für die oben ausgeführten Ergebnisse denkbar. Die verschlechterte Qualität könnte das Resultat von Ermüdungseffekten oder verminderter Anstrengung aufgrund des Ausbleibens realer Konsequenzen sein. Die erhöhte Geschwindigkeit bei der Fallbearbeitung könnte auch durch Lerneffekte zustande gekommen sein. Unklar bleibt zudem, inwieweit sich die Simulation unterschiedlich für Studierende und Berufstätige auswirkt.

Die Unterschiedlichkeit der Testgruppen (Studierende, Wissenschaftler, Team aus Gesundheitsbranche) ermöglichte es lediglich, die grundsätzliche Plausibilität des Szenarios über verschiedene fachliche Hintergründe hinweg bestätigen zu lassen. Trotz dieser Einschränkungen wirft die Studie einen Ansatz zur Entwicklung von KI-Kompetenz auf, dessen exakte Wirkung in umfangreicheren Studien zu untersuchen ist.

Die vorliegenden Ergebnisse machen deutlich, dass die Entwicklung von KI-Kompetenz für kollektive Problemlösungen einen Ansatz erfordert, der über den Aufbau technischen Verständnisses hinausgeht. Ein verantwortungsvoller Umgang mit KI schließt daher im besonderen Maße mit ein, die Veränderung von Denkprozessen bezüglich der Problemlösung bei KI-Einsatz zu antizipieren und geeignete Gegenmaßnahmen zu treffen. Dafür sind neben dem vorgestellten Ansatz im Mensch-KI-Rollenentwicklungslabor weitere erfahrungsbasierte Ansätze denkbar, die sich arbeitsplatznah in die betriebliche Praxis integrieren lassen.

Der Beitrag entstand im Rahmen des Forschungsprojekts HUMAINE, das durch das BMFTR-Förderprogramm „Zukunft der Wertschöpfung – Forschung zu Produktion, Dienstleistung und Arbeit“ gefördert wurde (Förderkennzeichen: 02L19C200).

Literatur

[1] Bankins, S.; Ocampo, A. C.; Marrone, M.; Restubog, S. L. D.; Woo, S. E.: A multilevel review of artificial intelligence in organizations: Implications for organizational behavior research and practice. In: Journal of organizational behavior 45 (2024) 2, S. 159–182.[2] Raisch, S.; Fomina, K.: Combining human and artificial intelligence: Hybrid problem-solving in organizations. In: Academy of Management Review 50 (2025) 2, S. 441–464.

[3] Annapureddy, R.; Fornaroli, A.; Gatica-Perez, D.: Generative AI literacy: Twelve defining competencies. In: Digital Government: Research and Practice 6 (2025) 1, S. 1–21.

[4] Lee, H.-P.; Sarkar, A.; Tankelevitch, L.; Drosos, I.; Rintel, S.; Banks, R.; Wilson, N.: The Impact of Generative AI on Critical Thinking: Self-Reported Reductions in Cognitive Effort and Confidence Effects From a Survey of Knowledge Workers. Proceedings of the 2025 CHI Conference on Human Factors in Computing Systems. Association for Computing Machinery 1121 (2025), S. 1–22.

[5] Li, H.; Kim, S.: Developing AI literacy in HRD: Competencies, approaches, and implications. In: Human Resource Development International 27 (2024) 3, S. 345–366.

[6] Bankins, S.; Formosa, P.: The ethical implications of artificial intelligence (AI) for meaningful work. In: Journal of Business Ethics 185 (2023) 4, S. 725–740.

[7] Wilkens, U.; Lupp, D.; Langholf, V.: Configurations of human-centered AI at work: seven actor-structure engagements in organizations. In: Frontiers in Artificial Intelligence (2023) 6, 1272159. DOI: https://doi.org/10.3389/frai.2023.1272159.

[8] Bick, A.; Blandin, A.; Deming, D. J.: The rapid adoption of generative AI (No. w32966). National Bureau of Economic Research. 2024.

[9] Al Naqbi, H.; Bahroun, Z.; Ahmed, V.: Enhancing work productivity through generative artificial intelligence: A comprehensive literature review. In: Sustainability 16 (2024) 3, 1166.

[10] Rampelt, F.; Ruppert, R.; Schleiss, J.; Mah, D. K.; Bata, K.; Egloffstein, M.: How do AI educators use open educational resources?: A cross-sectoral case study on OER for AI education. In: Open Praxis 17 (2025) 1, S. 46–63.

[11] Gerlich, M.: AI tools in society: Impacts on cognitive offloading and the future of critical thinking. In: Societies 15 (2025) 1, 6.

[12] Schuckart, A.: GenAI and Prompt Engineering: A Progressive Framework for Empowering the Workforce. In: Proceedings of the 29th European Conference on Pattern Languages of Programs, People, and Practices (2024), S. 1–8.

[13] Johri, A.; Schleiss, J.; Ranade, N.: Lessons for GenAI Literacy from a Field Study of Human-GenAI Augmentation in the Workplace. In 2025 IEEE Global Engineering Education Conference (EDUCON) (2025), S. 1–9.

[14] Kaspersen, M. H.; Musaeus, L. H.; Bilstrup, K. E. K.; Petersen, M. G.; Iversen, O. S.; Dindler, C.; Dalsgaard, P.: From primary education to premium workforce: Drawing on K-12 approaches for developing AI literacy. In: Proceedings of the 2024 CHI Conference on Human Factors in Computing Systems (2024), S. 1–16.

[15] Creswell, J. W.; Clark, V. L. P.: Designing and conducting mixed methods research. New York 2017.

Ihre Downloads

Potenziale: Führung Management Qualifizierung