Datenqualität und Expertise für robusten KI-Einsatz |

Integration von Anomalie- und Label-Fehlererkennung in industrielle Defektdetektion

| Zeitschrift | Industry 4.0 Science |

| Ausgabe | 42. Jahrgang, 2026, Ausgabe 1, Seite 128-135 |

| Open Access | https://doi.org/10.30844/I4SD.26.1.128 |

| Literatur | Teilen | Zitieren | Download |

Abstract

Keywords

Artikel

KI in der industriellen Qualitätskontrolle bietet erhebliche Chancen, aber geht auch mit komplexen Herausforderungen entlang der Mensch-KI-Schnittstelle einher, die eine Fokussierung auf angewandte Ethik und humanzentrierte Designprinzipien erfordern. In industriellen Umgebungen, etwa bei automatischen Oberflächeninspektionssystemen (ASIS) wird maschinelles Lernen zunehmend für Fehlererkennungsaufgaben eingesetzt (z. B. die Inspektion von Walzstahl).

Während Letzteres eine höhere Effizienz und Konsistenz verspricht, ergeben sich Herausforderungen hinsichtlich Vertrauen, Benutzerfreundlichkeit, Anpassungsfähigkeit und die Rolle menschlicher Arbeitskräfte. Bei der Standard-KI-Implementierung scheinen diese Aspekte oft vernachlässigt zu werden, was die Akzeptanz erschwert, und ethische Bedenken aufwirft. Dadurch ist es notwendig über einen humanzentrierte Ansätze für KI (HCAI) nachzudenken.

Dieser Artikel präsentiert die Ergebnisse einer wissenschaftlich-praktischen Zusammenarbeit mit einem ASIS-Anbieter. Wir haben Kernprobleme identifiziert, die die effektive Integration von ASIS in Produktionslinien beeinträchtigen können: Datenineffizienz (insbesondere bei seltenen Fehlern), Misstrauen der Nutzer aufgrund unklarem Modellverhalten und variabler Leistung, begrenzte KI-Kenntnisse der Nutzer, die die Anpassung behindern, und Informationsflut für die Bediener.

Wir argumentieren, dass diese praktischen Herausforderungen durch spezifische, auf HCAI abgestimmte technische Lösungen angegangen werden können, die sich auf Datenqualität, Modelltransparenz und Nutzerbefähigung konzentrieren. Wir stellen gemeinsam entwickelte Lösungen vor – Konzepte zur Anomalieerkennung, zur Erkennung von Label-Fehlern und zur Driftüberwachung –, um die Handlungsfähigkeit der Mitarbeiter, das Vertrauen und die nachhaltige Einführung von KI in der industriellen Oberflächeninspektion zu verbessern.

Unsere Beiträge sind: (1) die Identifizierung praktischer Herausforderungen bei der ASIS-Einführung als ethische HCAI-Defizite, (2) die Zuordnung dieser Herausforderungen zu HCAI-Lösungen, wodurch (3) gezeigt wird, wie KI-Ethik einen Rahmen für die Lösung praktischer Herausforderungen bei der Zusammenarbeit zwischen Mensch und KI in der Industrie bieten kann, und (4) die Vorstellung technischer Lösungen für das Bewusstsein für Datenqualität und das Zuverlässigkeitsmanagement.

Hintergrund

Eine effektive und ethische Integration von KI in den Arbeitsplatz erfordert ein Verständnis sowohl der Zuverlässigkeit von KI als auch der Prinzipien einer menschenzentrierten Arbeitsgestaltung. Angewandte KI-Ethik befasst sich mit den Bereichen Fairness, Verantwortlichkeit, Transparenz und Auswirkungen auf die Arbeit. HCAI bietet einen Rahmen, um diese Herausforderungen in drei Schlüsselbereichen anzugehen [1, 2]:

- Die Technologieentwicklung befasst sich mit der Gewährleistung einer konsistenten und robusten Leistung (Vertrauenswürdigkeit/Zuverlässigkeit) und der Verständlichkeit der Ergebnisse (Erklärbarkeit).

- Die Mitarbeiterentwicklung konzentriert sich darauf, Menschen zu befähigen, anstatt sie zu ersetzen (menschliches Handeln und Erweiterung), und zumutbare Arbeitsbedingungen zu gewährleisten (nachhaltige Arbeitsgestaltung).

- Die Organisationsentwicklung strebt eine ethische Datenverwaltung an, indem sie zuverlässige Wissensdatenbanken der Organisation pflegt (verantwortungsbewusstes Wissensmanagement/Rechenschaftspflicht)und Fachwissen der Anwender integriert, damit auch Nicht-Experten die Qualität der KI verwalten können.

Werden diese Dimensionen vernachlässigt, entstehen Systeme, die zwar technisch funktionsfähig, für die Endnutzer jedoch praktisch unbrauchbar oder unzuverlässig sind [3].

Auf technischer Ebene hängt die Leistung der KI von der Datenqualität ab. Häufige Probleme bei industriellen Anwendungen sind Label-Fehler, Ausreißer und unzureichende Daten für seltene Klassen. Die Anomalieerkennung hilft bei der Identifizierung neuartiger oder seltener Ereignisse, was für eine robuste Defekterkennung von entscheidender Bedeutung ist. Die Erkennung von Label-Fehlern verbessert die Integrität des Datensatzes und die Zuverlässigkeit der Modellbewertung. Domain-Drift stellt eine große Herausforderung für die Modellleistung dar und erfordert eine Überwachung, um Verschiebungen in der Datenverteilung zu erkennen und auf sich ändernde Bedingungen wie wechselnde Lichtverhältnisse oder Materialschwankungen zu reagieren. Konfidenzangaben des Modells können irreführend sein, insbesondere bei Drift, was eine driftbewusste Vertrauenskalibrierung erforderlich macht.

Vorherige Arbeiten in diesem Forschungsprojekt verwendeten einen kollaborativen, interdisziplinären Ansatz, an dem akademische Forscher (Informatik, Ingenieurwesen, Sozialwissenschaften, Informationssysteme), ein industrieller ASIS-Anbieter und ASIS-Qualitätsingenieure beteiligt waren, um Herausforderungen für ein humanzentriertes KI-Design zu identifizieren. Diese Arbeit nutzte interdisziplinäre Workshops mit Stakeholdern (Systementwickler, Projektmanager), Feedback von Endnutzern und strukturierte Potenzial- und soziotechnische Workflow-Analysen [4].

Die Nutzerbedürfnisse wurden durch semi-strukturierte Interviews mit Qualitätsingenieuren und Anlagenbedienerbewertet und mittels Transkripten von Audioaufzeichnungen dokumentiert. Die Interviewtranskripte wurden mit systematischen qualitativen Methoden analysiert, um Designprinzipien für ASIS-Schnittstellen abzuleiten und Nutzerrollen durch Personas zu charakterisieren [5]. Durch diese Methoden wurden relevante Workflows, Problemfelder (z. B. Zeitdruck bei der Inbetriebnahme) und HCAI-Lücken identifiziert.

Methodik: Überführung von HCAI-Herausforderungen in technische Lösungen

Die Autoren der vorliegenden Studie, die an den ursprünglichen Workshops teilgenommen und Zugang zu den Interviewtranskripten hatten, haben gemeinsam die dokumentierten Schwachstellen in Gesprächen mit dem ASIS-Anbieter und den Stakeholdern analysiert. Durch diesen iterativen Austausch kristallisierten sich wiederkehrende Themen heraus. Diese wurden den Dimensionen des HCAI-Frameworks zugeordnet [1, 2], sodass wir die identifizierten Bedürfnisse in konkrete technische Anforderungen umsetzen konnten.

Die Lösungen wurden gemeinsam entwickelt, indem die identifizierten HCAI-Anforderungen in technische Anforderungen übersetzt wurden. Die technischen Ansätze wurden aufgrund ihrer Einfachheit, Verständlichkeit, Umsetzbarkeit und ihres Potenzials für eine modellunabhängige Anwendung ausgewählt. Technische Prototypen wurden auf der Grundlage proprietärer industrieller Stahlband-Datensätze entwickelt, die vom ASIS-Lieferanten bereitgestellt wurden. Die Datensätze bestanden aus zwei gelabelten tabellarischen Defektdatensätzen, die Merkmale aus Fehler- sowie Stahlbandoberflächenbildern für visuelle Erkennungsaufgaben enthielten. Die Prototypen wurden durch interne Tests mit dem ASIS-Lieferanten (unter Verwendung von Validierungsmetriken und Benutzertests) und Kundenfeedback validiert [5, 6].

Fallstudie: KI in automatisierten Oberflächeninspektionssystemen (ASIS)

Wir haben den Einsatz von ASIS-Produkten fürStahlwalzen untersucht, die die Qualität der Stahlbändern mithilfe von KI automatisch bewerten und möglicherweise minderwertige Bänder kennzeichnen sollen. Nachdem diese Systeme vom Anbieter installiert werden, muss das KI-Modell während der Inbetriebnahme angepasst und möglicherweise später für sich ändernde Bedingungen oder Anforderungen neu trainiert werden.

Der typische Arbeitsablauf beim ASIS-Kunden umfasst die Bildaufnahme vor Ort, die manuelle Fehlerklassifizierung für den Trainingsdatensatz, die Echtzeit-Fehlererkennung auf Basis von Computer Vision und die Klassifizierung mithilfe von KI [7]. Zu den Hauptnutzern gehören drei primäre Rollen: Anlagenbediener, die die Produktion leiten und sofortiges Feedback zur aktuellen Prozessqualität benötigen; Qualitätsingenieure, die überwachen, ob die Produktqualität den Anforderungen entspricht; und ASIS-Administratoren, die Daten verwalten und aktualisieren, die Systemergebnisse pflegen und bei Bedarf die Leistung optimieren.

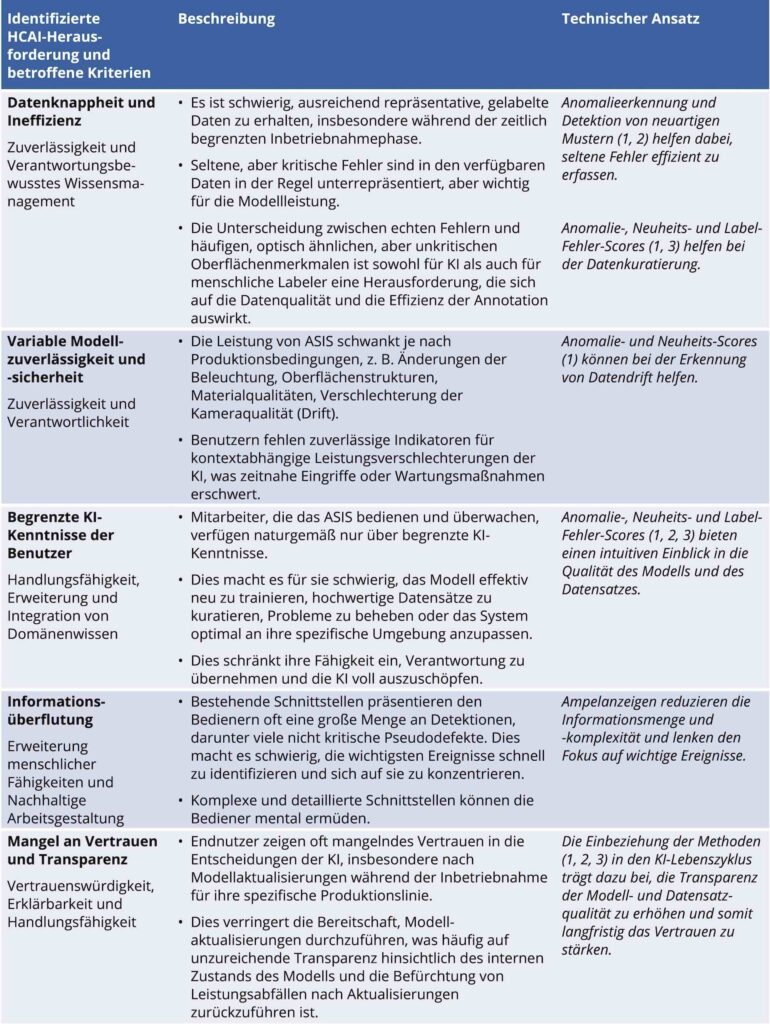

Die Anwendung unserer Methodik auf KI in ASIS hat spezifische HCAI-Herausforderungen aufgezeigt, die wir in Bild 1 darstellen.

Um diesen Herausforderungen zu begegnen, schlagen wir drei technische Lösungen vor:

Lösung 1: Erkennung von Anomalien und neuen Klassen in tabellarischen Daten

Um der Datenknappheit für seltene oder neue Fehler unter Verwendung tabellarischer Daten zu begegnen, haben wir unüberwachte Methoden zur Anomalieerkennung untersucht [8, 9]. Verschiedene Algorithmen wurden anhand der beiden industriellen tabellarischen Datensätze evaluiert, darunter distanzbasierte, statistische, lineare und Ensemble-Methoden. Der vielversprechendste Ansatz war eine Kombination aus einem distanzbasierten Algorithmus (Connectivity-based Outlier Factor (COF)) [10] und der Entropie der vorhergesagten Klassenwahrscheinlichkeiten.

Diese Methode bewertet die „Ungewöhnlichkeit“ von Erkennungen im Verhältnis zu den Trainingsdaten des Modells auf der Grundlage sowohl der Isolierung im Merkmalsraums der Stichprobe als auch der Klassifikator-Konfidenz. Zur Evaluierung der Methode simulierten wir Anomalien, indem wir die Datenpunkte seltener Klassen aus dem Datensatz weggelassen haben (ca. 3 % der Daten). Als Metrik zur Untersuchung der Ranking-Qualität und der Fähigkeit zur Unterscheidung zwischen normalen und anomalen Datenpunkten wurde die mittlere Fläche unter der Receiver Operating Characteristic(AUROC) gewählt.

Der kombinierte Ansatz unter Verwendung von COF- und entropiebasierten Werten erzielte mit AUROCs von 80,36 % und 83,14 % die beste Gesamtleistung über die beiden getesteten Datensätze hinweg. Angesichts der Unterrepräsentation von der Defekten in den Datensätzen und der False-Positive-Rates von 37,58 % und 35,77 % bei einer True-Positive-Rate von 85 % leidet die vorgeschlagene Methode zwar immer noch unter Fehlalarmen, identifiziert jedoch Anomalien und Neuheiten recht robust.

Durch die Identifizierung von Anomalien unterstützt das System das Bewusstsein für Datenqualität und kann aktive Lernabläufe steuern, indem es Benutzer dazu auffordert, ungewöhnliche Proben zu überprüfen, die möglicherweise falsch gelabeled sind oder zu neuen Klassen gehören. Dies verbessert nicht nur die Handlungsfähigkeit der Benutzer, sondern trägt auch zu einem verantwortungsvollen Wissensmanagement bei, indem es die Wahrscheinlichkeit verringert, dass fehlerhafte oder unvollständige Daten in die Wissensdatenbanken von Organisationen gelangen.

Lösung 2: Visuelle Anomalieerkennung auf Bilddaten

Ergänzend zum tabellarischen Ansatz haben wir eine visuelle Anomalieerkennung direkt auf Bildern der Stahlbandoberfläche implementiert, um die Fehlerlokalisierung mithilfe von Zero-Shot-Lernen (ohne Bereitstellung von Fehlerbeispielen) und semi-überwachtem Few-Shot-Lernen zu verbessern, wodurch umfangreiche Fehlerbeispiele überflüssig werden. Wir haben AnomalyDINO [11] angepasst, einen patchbasierten Deep-Nearest-Neighbor-Ansatz, der Merkmale aus dem vortrainierten DINOv2-Vision-Transformer verwendet. Bei dieser Methode werden visuelle Patches aus Testbildern mit einer Speicherbank von Referenz-Patches „guter” Oberflächen verglichen, um Abweichungen zu identifizieren. Für ASIS enthalten die Referenz-Patches nur fehlerfreie Stahlbandbilder.

Die interne Bewertung anhand der zwei Stahlband-Datensätzen zeigte eine starke Leistung mit AUROC-Werten von 98,45 % und 97,0–98,52 %, wobei sich die Leistung von 16 auf 100 Referenzaufnahmen verbesserte. Die Zero-Shot-Analyse erreichte 99,13 % AUROC durch unüberwachte Anomalieerkennung und Quantiloptimierung auf einem anderen proprietären Datensatz. Allerdings hat der Ansatz Schwierigkeiten, sehr kleine Anomalien wie Ölflecken oder Kratzer zu erkennen, die die Anomalie-Scores möglicherweise nicht ausreichend erhöhen, und könnte von einer weiteren Hyperparametersuche profitieren.

Lösung 3: Erkennung von Label-Fehlern

Um die Integrität des Datensatzes und das Vertrauen in die Modellbewertungen zu verbessern, haben wir einen Algorithmus entwickelt, um Datenpunkte in den Trainings- und Validierungsdaten mit wahrscheinlich falschen Labels zu identifizieren. Wir haben die Ranking-Methode „Area Under the Margin“ (AUM) [12] für gradient-boosted Decision Trees [6] angepasst. Die Methode berechnet einen Score für jeden Datenpunkt, indem sie den Abstand zwischen der vorhergesagten Wahrscheinlichkeit der zugewiesenen Klasse und der nächstwahrscheinlichsten Klasse über alle Boosting-Schritte während eines einzigen Trainingslaufs mittelt.

AUM erwies sich als rechnerisch effizient und erforderte nur einen Trainingslauf. Bei den beiden industriellen tabellarischen Datensätzen erzielte AUM AUROC-Werte von 97,1 % und 96,2 % für die Erkennung von 5 % injiziertem synthetischem asymmetrischem Label-Rauschen [13], was vergleichbar mit rechenintensiveren Out-of-Sample-Vorhersagemethoden ist [6]. In zwei Validierungssitzungen mit Fachleuten aus der Industrie wurden 42 % der Datenpunkte mit den niedrigsten AUM-Werten als Label-Fehler bestätigt, während andere auf weitere Datenqualitätsprobleme hinwiesen, was den praktischen Nutzen der Methode bestätigte.

Die Vorlage von Datenpunkten mit niedrigem AUM-Wert an Qualitätsingenieure ermöglicht eine gezielte Überprüfung und Korrektur der Labels. Dies verbessert die Handlungsfähigkeit und Augmentierungder Benutzer, da Ingenieure Daten effizienter und mit geringerem manuellem Aufwand kuratieren können, was wiederum ein verantwortungsbewusstes Wissensmanagement unterstützt, indem das Risiko verringert wird, dass die Wissensdatenbanken des Unternehmens durch falsch beschriftete Daten verfälscht werden. Außerdem trägt es dazu bei, einen Konsens über die Kriterien für die Fehlerklassifizierung zu erzielen.

Integrationsausblick

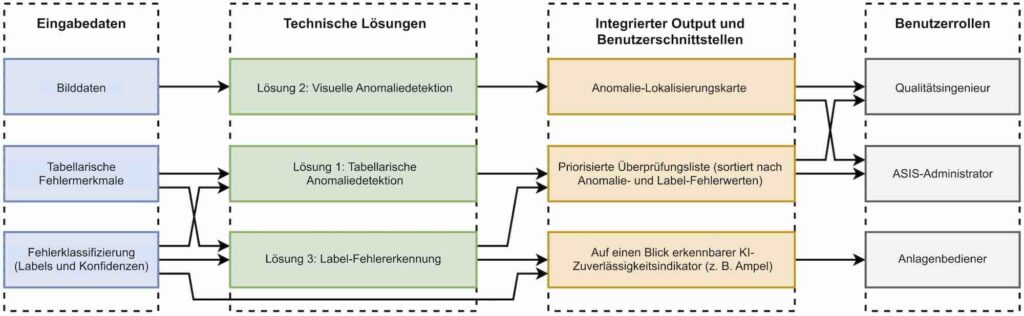

Diese Lösungen lassen sich in bestehende ASIS-Software und -Workflows integrieren (Bild 2). Anomalie- und Label-fehlerwerte werden zusammen mit Fehlererkennungen in tabellarischen Ansichten angezeigt, die von Qualitätsingenieuren verwendet werden, und ermöglichen das Sortieren und Filtern, um eine priorisierte Überprüfung zu ermöglichen. Die Anomalielokalisierung kann auf Stahlbandbilder projiziert oder zur Fehlerlokalisierung verwendet werden.

Um Informationen zur Modellzuverlässigkeit zugänglich zu machen und die Informationflut für Bediener zu minimieren, schlagen wir einen einfachen „Ampel”-Indikator vor, der Informationen aus mehreren Quellen – wie Verteilungen der Anomalie-Scores und Modellkonfidenzniveaus – zu einer übersichtlichen KI-Zuverlässigkeitsbewertung für Echtzeit-Überwachungsschnittstellen zusammenfasst.

Diese könnte in der Echtzeit-Überwachungsschnittstelle des Bedieners angezeigt werden. Die Kombination detaillierter Bewertungen für die Expertenüberprüfung mit abstrakten Indikatoren für Bediener unterstützt eine fundierte Entscheidungsfindung über alle Rollen hinweg: Die Ampelvisualisierung reduziert die kognitive Belastung, indem sie die Menge und Komplexität der Informationen, die Bediener verarbeiten müssen, verringert, was zu einer nachhaltigen Arbeitsgestaltung beiträgt und ihren Fokus auf wichtige Ereignisse verlagert (Augmentation). Gleichzeitig stärken detaillierte Anomalie- und Label-Fehler-Scores das Vertrauen der Ingenieure und statten sie für ein verantwortungsbewusstes Wissensmanagement bei datengestützten Entscheidungen aus.

Diskussion und Fazit

Die gemeinsam entwickelten Prototypen, die durch Laborsimulationen und Feedback-Sitzungen mit Anwendern aus der Praxis validiert wurden, zeigen, dass die Berücksichtigung der Daten- und Modellqualität aus einer HCAI-Perspektive die Handlungsfähigkeit der Anwender unterstützt und die Systemresilienz in industriellen ASIS verbessern kann.

Das Feedback der Nutzer aus den Validierungssitzungen bestätigte den Mehrwert unserer Lösung zur Erkennung von Label-Fehlern: Die Bereitstellung von Scores zur Einstufung potenzieller Label-Fehler reduziert den manuellen Aufwand für die Datenqualitätssicherung im Vergleich zu nicht gezielten manuellen Überprüfungen deutlich, was sich in einer Identifizierungsrate von 42 % auf Basis der Label-Fehler-Scores im Vergleich zu den durchschnittlichen Label-Fehlerhäufigkeiten (z. B. weniger als 5 %) zeigte, was von den ASIS-Nutzern sehr geschätzt wurde [6]. Die dateneffiziente Anomalieerkennung auf Bildebene erwies sich als wirksam bei der Erkennung von Oberflächenfehlern in Kundendaten.

Insgesamt sind technische Lösungen, die sich auf die Transparenz der Datenqualität konzentrieren, für den Aufbau einer vertrauenswürdigen, widerstandsfähigen industriellen KI von entscheidender Bedeutung. Sie schlagen eine Brücke zwischen algorithmischen Fähigkeiten und praktischer Nutzbarkeit, indem sie Fachleuten die Möglichkeit geben, die Leistung der KI zu verstehen, zu validieren und zu verbessern.

Auf diese Weise verbessern sie direkt die Handlungsfähigkeit (durch effizientere Arbeitsabläufe), die Vertrauenswürdigkeit (durch transparente Zuverlässigkeitsüberwachung) und das verantwortungsvolle Wissensmanagement (durch Verbesserung der Datenintegrität). Wir haben die identifizierten Herausforderungen mit Strategien für ethische und effektive HCAI angegangen, die unserer Meinung nach über die industrielle ASIS hinaus übertragbar sind. Wir fassen diese Strategien in Bild 3 zusammen.

Diese Strategien sind relevant für Bereiche, die eine zuverlässige KI mit robuster menschlicher Aufsicht erfordern, wie sicherheitskritische Anwendungen, bei denen Datenknappheit und Zuverlässigkeit ein Problem darstellen.

Durch die Konzentration auf humanzentrierte Prinzipien und die gemeinsame Entwicklung technischer Lösungen für die Überwachung der Datenqualität und -zuverlässigkeit zeigt diese Zusammenarbeit zwischen Wissenschaft und Praxis, wie KI-Systeme zu transparenten, vertrauenswürdigen Partnern werden können, die die menschlichen Fähigkeiten erweitern. Wir haben wichtige industrielle ASIS-Herausforderungen – Datenineffizienz, Vertrauensdefizite, variable Zuverlässigkeit, Fachwissenslücken – identifiziert und angegangen, indem wir sie als Defizite in der Humanzentrierung analysiert und integrierte Lösungen entwickelt haben: Methoden zur Erkennung von Anomalien und zur Erkennung von Label-Fehlern.

Diese Ansätze verbessern die Handlungsfähigkeit der Nutzer durch Datenkuratierung und das Leiten der Nutzeraufmerksamkeit, verbessern das verantwortungsvolle Datenmanagement und unterstützen eine nachhaltige Arbeitsgestaltung durch Reduzierung der kognitiven Belastung.

Dieses Forschungs- und Entwicklungsprojekt wird vom Bundesministerium für Forschung, Technologie und Raumfahrt (BMFTR) im Rahmen des Programms „Die Zukunft der Wertschöpfung – Forschung zu Produktion, Dienstleistungen und Arbeit“ (02L19C200) gefördert und von der Projektmanagementagentur Karlsruhe (PTKA) verwaltet. Die Autoren sind für den Inhalt dieser Veröffentlichung verantwortlich.

Literatur

[1] Wilkens, U.; Langholf, V.; Ontrup, G.; Kluge, A.: Towards a maturity model of human-centered AI – A reference for AI implementation at the workplace. In: Schriftenreihe der Wissenschaftlichen Gesellschaft für Arbeits- und Betriebsorganisation (WGAB) e.V. (2021), S. 179–198. DOI: https://doi.org/10.30844/wgab_2021_11.[2] Wilkens, U.; Lupp, D.; Langholf, V.: Configurations of human-centered AI at work: seven actor-structure engagements in organizations. In: Front. Artif. Intell. 6 (2023). DOI: https://doi.org/10.3389/frai.2023.1272159.

[3] Mazarakis, A.; Bernhard-Skala, C.; Braun, M.; Peters, I.: What is critical for human-centered AI at work? – Toward an interdisciplinary theory. In: Front. Artif. Intell. 6 (2023). DOI: https://doi.org/10.3389/frai.2023.1257057.

[4] Bülow, F. et al.: Towards an approach for analyzing potentials for development and deployment of human-centered artificial intelligence solutions. In: Technologie und Bildung in hybriden Arbeitswelten (2022).

[5] Nauth, K.; Ünal, E.; Meske, C.; Poeppelbuss, J.: How to design the interplay between humans and AI-based surface inspection systems. In: Procedia CIRP (2024). In press.

[6] Rath-Manakidis, P. et al.: Label Error Detection in Defect Classification using Area Under the Margin (AUM) Ranking on Tabular Data. In: Wirtschaftsinformatik 2025 Proceedings (2025). In press.

[7] Saridis, G. N.; Brandind, D. M.: An automatic surface inspection system for flat rolled steel. In: Automatica 15 (1979) 5, S. 505-520. DOI: https://doi.org/10.1016/0005-1098(79)90001-3.

[8] Unger, M. F.: Anomaly Detection on Tabular Data for Industrial Weld Defect Classification. Thesis, Ruhr-University Bochum, Bochum, 2024.

[9] Salehi, M. et al.: A Unified Survey on Anomaly, Novelty, Open-Set, and Out-of-Distribution Detection: Solutions and Future Challenges. In: Transactions on Machine Learning Research (2022). DOI: https://doi.org/10.48550/ARXIV.2110.14051.

[10] Feasal, K.: Connectivity-Based Outlier Factor (COF). In: Finding Ghosts in Your Data. In: Finding Ghosts in Your Data (2022), S. 185-201. DOI: https://doi.org/10.1007/978-1-4842-8870-2_10.

[11] Damm, S.; Laszkiewicz, M.; Lederer, J.; Fischer, A.: AnomalyDINO: Boosting Patch-based Few-Shot Anomaly Detection with DINOv2. In: 2025 IEEE/CVF Winter Conference on Applications of Computer Vision (WACV), IEEE Computer Society (2025), S. 1319–1329. DOI: https://doi.org/10.1109/WACV61041.2025.00136.

[12] Pleiss, G.; Zhang, T.; Elenberg, E.; Weinberger, K. Q.: Identifying Mislabeled Data using the Area Under the Margin Ranking. In: Proceedings of the 34th International Conference on Neural Information Processing Systems (2020), S. 17044–17056. DOI: https://doi.org/10.48550/arXiv.2001.10528.

[13] Chen, P.; Liao, B.; Chen, G.; Zhang, S.: Understanding and Utilizing Deep Neural Networks Trained with Noisy Labels. In: Proceedings of the 36th International Conference on Machine Learning (2019), S. 1062–1070. URL: https://proceedings.mlr.press/v97/chen19g.html.

Ihre Downloads

Potenziale: Dynamik